面对“数据洪水”,人类如何“诺亚方舟”?

作者|图灵 来源|图灵TOPIA(ID:turingtopia)

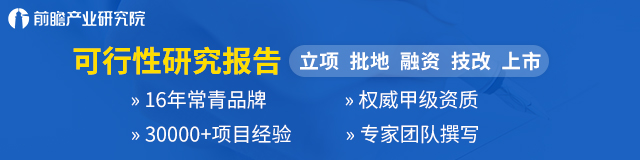

大体上看,人力计算能力经历了三个阶段:

远古时期以结绳计数为代表,只能进行简单的计数;

农耕文明时期,开始利用物理器械进行计算,典型代表是中国的算盘,西方文明于近代开始发展计算钟等机械式计算器;

电子计算器、集成电路的发明,让人类开始进入“算力爆炸”时代,计算能力以指数级提升。

据IDC预测,全球数据总量预计2020年达到44个ZB,我国数据量将达到8060个EB,占全球数据总量的18%。

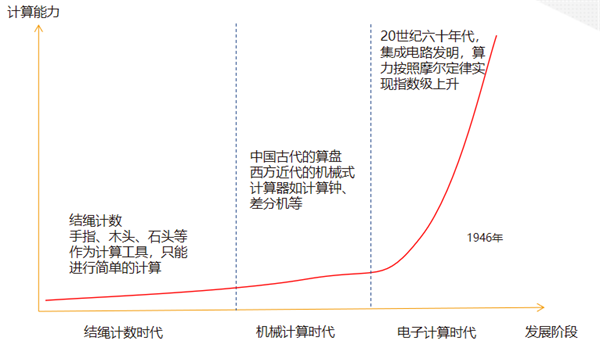

尤其是随着5G网络的建设,来自eMMB、mMTC、uRLLC三类应用场景的数据量将大大增加,尤其来自视频应用、城市高清监控摄像机、工业摄像机、医学影像等产生大量的4K视频、8K视频等高清晰度视频,以及VR、AR、全息影像等。

整个社会将迎来“数据洪峰”,亟需快速提升数据传输、存储、计算和应用能力。

高清视频、VR等流量预测单位(EB/月)数据来源:IHS华泰证券研究所

戈登·摩尔提出“摩尔定律”——集成电路芯片上所集成的晶体管数目(处理器性能),每隔18个月就翻一番。

与之类似的,图灵奖获得者JimGray提出“数据摩尔定律”——每18个月全球新增信息量是计算机有史以来全部信息量的总和。

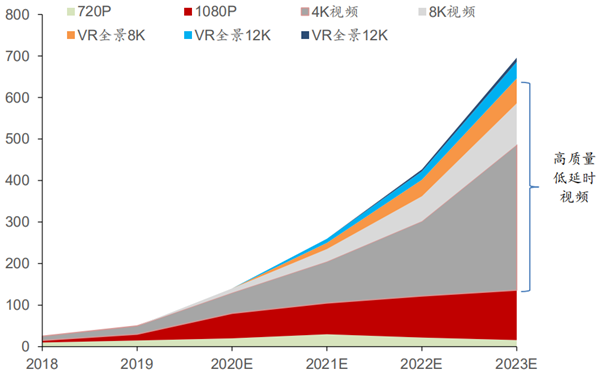

深度学习为代表的人工智能算法本质是基于概率统计理论的“暴力计算”模式,消耗大量算力,其需求遵循“AI摩尔定律”——自2012年以来人工智能训练任务使用的计算能力每3.5个月提升一倍,目前增长已超过30万倍。

可以预见,在未来几年,将很快越过算力供需平衡点,维持较长时间的算力缺口。传统摩尔定律很快抵达极限,人类面临算力停滞的危机。

在很长一段时间内,人类都将面临“算力短缺”的难题,如何解决这一问题,是人类进入下一个发展阶段的关键。

要提升人类的算力水平,可以分为短期和长期两个阶段:

短期来看,通过云计算+异构计算的方式,来缓解算力短缺情况。

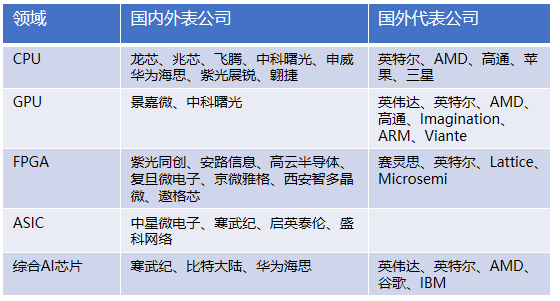

目前主要的异构计算方式是实现CPU+GPU+FPGA+ASIC的融合,终端芯片的异构计算已经比较常见,云端异构计算才刚起步,是提升云端算力的关键。

CPU、GPU、FPGA、ASIC计算芯片不断升级,并借助专用计算单元提升专用领域的适用性。CPU围绕深度学习计算需求增加专用计算指令;

GPU持续优化针对人工智能计算的专用逻辑运算单元,应用领域由早期图像处理逐步拓展至通用加速;

FPGA提升面向各类工作负载需求的异构计算能力,以实现边缘智能等更多场景的规模应用;

ASIC围绕深度学习指令集、高并行计算架构、高能效访存架构、高速低延时互联等方面进行持续创新,ASIC芯片依据场景需求和AI算法特点进行定向优化也是其重要的创新方向。

众多厂商相继推出融合异构计算的数据解决方案,比如华为的FusionInsightB160数据智能方案内置Kunpeng920+Atlas300C芯片,腾讯云推出的搭载赛灵思数据中心加速卡的FPGA实例FX4、融合NVIDIAT4的GPU实例GN7等。

长期来看,量子计算的突破将把人类带进“算力自由”时代。

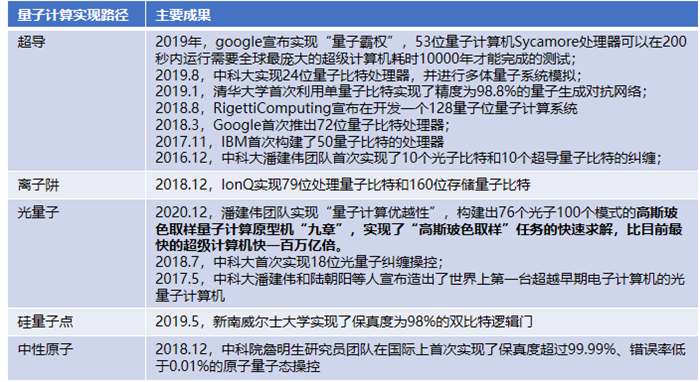

量子计算基础理论创立于二十世纪八十年代,经过基础理论探索、编码算法研究两个阶段以后,目前已经进入到实验验证和样机研发的过程中。目前量子计算机的物理体系主要包含超导、离子阱、硅量子点、中性原子、光量子、金刚石色心和拓扑等。超导和离子阱路线相对领先,未来趋势或将走向一种多路线并存的混合体系。

目前,“量子优越性”突破里程碑,实用化尚有距离,通过云服务进行量子处理器的接入和量子计算应用推广成为量子计算算法及应用研究的主要形式之一。

Google、IBM、英特尔、微软在量子计算领域布局多年,我国阿里巴巴、腾讯、百度和华为近年来通过与科研机构合作也在进行布局,如阿里与中科大联合发布的量子模拟器“太章”,华为在2018年发布HiQ量子云平台,并在2019年推出昆仑量子计算模拟一体原型机。

可以说,以AI芯片和量子计算,就是人类的“诺亚方舟”,帮助人类在数据的汪洋大海中尽情遨游。

编者按:本文转载自微信公众号:图灵TOPIA(ID:turingtopia),作者:图灵

广告、内容合作请点这里:寻求合作

咨询·服务